Google объяснила, как добиться быстрой индексации – внесения информации об интернет-ресурсе в поисковую базу – контента на сайте. Для ускорения попадания в результаты выдачи представители компании рекомендуют использовать HTML.

Оперативный HTML

HTML (HyperText Markup Language) – наиболее популярный язык разметки в Интернете для создания веб-ресурсов. Большая часть содержимого сайтов отображается именно благодаря ему. HTML-код указывает браузеру, как должна быть сгенерирована страница. И, как недавно выяснилось, использование этого языка улучшает индексацию сайта в Google.

Специалист по качеству поиска Google Джон Мюллер в обсуждении двухэтапной системы индексации веб-ресурсов раскрыл некоторые особенности работы алгоритмов поисковика. Отвечая на вопрос в своем Twitter-аккаунте, он сообщил, что поисковый бот быстрее обрабатывает страницы, представленные в виде HTML-кода. Разработчик отметил, что особенно этот совет актуален для сайтов, которые часто обновляют контент: он сможет оперативнее попадать в результаты выдачи.

Эту же информацию подтвердил и SEO-консультант Алан Блейвейс. Он поделился в Twitter своим опытом и указал на то, что содержимое страницы, сгенерированное с помощью JavaScript, может ожидать полной индексации несколько недель.

Почему Googlebot тормозит

Googlebot, инструмент поисковой системы для рендеринга страниц и анализа их содержимого, имеет ограниченные ресурсы. Сайты, активно использующие JavaScript, требуют много вычислительной мощности для того, чтобы сгенерировать свое содержимое. Из-за недостатка ресурсов поисковый бот не может сразу изучить контент на «тяжелых» сайтах, потому что иначе индексация будет занимать слишком много времени.

Чтобы избежать этой проблемы, Googlebot использует двухэтапную систему анализа. При первом заходе на сайт робот обрабатывает «легкий» HTML-код и индексирует контент, который в нем находит. Во время второго обхода, когда поисковый бот получит достаточно ресурсов для детального изучения сайта, генерируется остальное содержимое, которое в первый раз Googlebot посчитал слишком тяжеловесным.

Промежуток между двумя визитами робота обычно составляет не менее одной недели, что и приводит к значительно более быстрой индексации HTML-контента.

Борьба за чистоту выдачи

Также Джон Мюллер на онлайн-конференции поделился информацией о том, как поисковый робот отличает уникальный контент на странице от сгенерированного автоматически. По словам специалиста, пока что Googlebot не всегда может выявить уровень качества содержимого и определить, где используется авторский текст, а где – созданный с помощью машинного перевода.

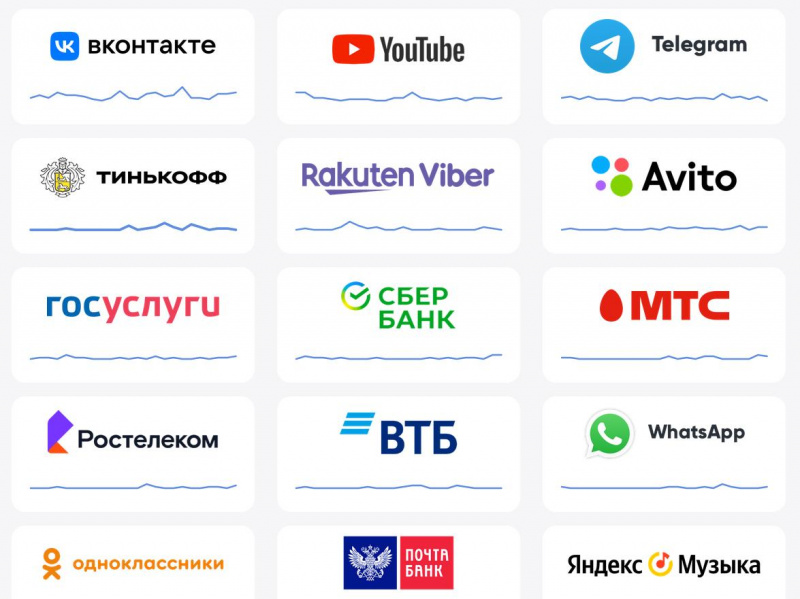

Такие веб-ресурсы с «бредотекстом» используются вебмастерами для быстрого заработка с минимальным вложением средств. Google активно борется с сайтами, захламляющими поисковую выдачу бессмысленным контентом и относит их к категории спамных.

Мюллер видит проблему в создании алгоритма, способного успешно определять случаи злоупотребления машинным переводом. Не всегда его использование – однозначная проблема. Нередко владельцы сайтов прибегают к подобному инструменту, чтобы создать мультиязычную версию веб-страницы, особенно если необходимо представить контент на экзотических языках для небольшой аудитории. Такие веб-ресурсы не стоит наказывать, уверен Мюллер.

Сотрудник Google обратился к сообществу вебмастеров с просьбой присылать примеры случаев, где поисковые алгоритмы не смогли успешно определить качество содержимого и ошибочно применили к сайту пессимизацию в выдаче. Это поможет сделать инструмент лучше и точнее.